Danske journalister forholder sig efterhånden hyppigt og kvalificeret til statistisk signifikans og usikkerhed – i meningsmålingsjournalistik: ”… en tilbagegang der lige akkurat er større end den statistiske usikkerhed og derfor er signifikant”. Og “ingen af de to blokke fører dog signifikant … Dødt løb, hvis man tager den statistiske usikkerhed i betragtning“.

Glædeligt – men er det sandt, hvis det er signifikant?

Ikke nødvendigvis, og det ved danske journalister da også godt: “Målingen står indtil videre alene, og derfor skal man være varsom med konklusionerne, men hvis billedet bekræftes af andre meningsmålinger …“.

Klog betragtning. Den kan journalister roligt overføre på forskningsresultater generelt.

Røde kort til sorte spillere

Data kan analyseres statistisk på mange forskellige måder! Forskere skal med andre ord træffe nogle metodevalg, som er styrende for deres statistiske analyser og i sidste ende for de resultater, de offentliggør. Disse valg er i høj grad subjektive, hvor velbegrundede og velargumenterede de end måtte fremstå – og leder til forskellige resultater. Ralph Silberzahn (IESE Business School, Barcelona) og Eric Luis Uhlmann (Insead, Singapore) besluttede at lave et eksperiment, hvor de ville teste, hvordan forskere i praksis træffer forskellige metodevalg, og hvordan det påvirker deres resultater.

29 forskerteams fra hele verden blev stillet samme forskningsspørgsmål: Giver fodbolddommere flere røde kort til sorte spillere end til hvide? De 29 teams, som alle bestod af fagstatistikere, fik det samme datasæt til rådighed og frie hænder til at foretage analysen. Data bestod af samtlige spillere i den bedste række i Spanien, England, Tyskland og Frankrig i sæsonen 2012-2013 og disse spilleres interaktioner med dommere i hele deres professionelle karriere, herunder hvilke røde kort de måtte have fået af hvilke dommere. Alle spillere blev desuden på forhånd kodet efter hudfarve, plads på holdet og en række andre ting.

Forskerens subjektive valg

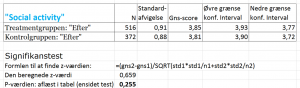

Denne analyse er vel ret ligetil? Ikke i praksis – viste det sig. 20 forskerteams konkluderede, at hudfarve havde en statistisk signifikant effekt på antallet af rødt kort, altså at sorte spillere får flest røde kort. 9 teams konkluderede, at der ikke var en signifikant sammenhæng. Hvordan kunne det falde så forskelligt ud? Det skyldes, at de 29 teams foretog en række forskellige metodevalg, som ikke er entydigt rigtige eller forkerte – særligt på to områder: 1) De anvendte modeller, som bygger på forskellige statistiske fordelinger; 2) De valgte at kontrollere for forskellige faktorer, fx om den enkelte spiller er forsvarsspiller eller angrebsspiller.

Nu er det sjældent, at journalister præsenteres for 29 simultane analyser baseret på samme forskningsspørgsmål, men mindre kan også gøre det. Eksperimentet viser med al ønskelig tydelighed, at man skal være varsom med at konkludere på en enkeltstående statistisk analyse – selv om den måtte fortælle, at en sammenhæng er signifikant. Eller ikke-signifikant. Mere generelt – og almindeligt – er god, valid forskning blandt andet kendetegnet ved, at andre forskere kan gentage forsøget eller analysen og nå frem til nogenlunde samme resultat, men som bl.a. Jens Ramskov fint har beskrevet i en artikel om samme emne, så viser gentagelseseksperimenter, at overraskende mange forskningsresultater ikke lader sig reproducere.

En svær, men vigtig journalistisk opgave

Det er altså en forbandet god ide altid at spørge, om resultatet står alene eller kan bekræftes af andre lignende forskningsresultater, når man præsenteres for ny forskning.

Det kræver fagekspertise hos den enkelte journalist. Mange danske journalister er eksperter i meningsmålinger og kan på et øjeblik vurdere, om en ny måling ser ”underlig” ud; om der er tale om et ekstremt resultat. Vanskeligere er opgaven, når det gælder alle mulige andre undersøgelser, som (måske?) skal formidles. Men man bør tjekke, om resultaterne understøttes af anden anerkendt forskning. Og forholde sig til metodevalgene. En nylig undersøgelse af forskningsbaseret dækning af udsatte børn og unge, som jeg selv var med til at lave, konkluderer, at forskere på dette fagområde generelt efterlyser større kritisk sans og forståelse af forskningsmetoder og -paradigmer hos journalisterne. Det er vanskeligt, men ikke desto mindre en vigtig journalistisk opgave. Det er ikke nødvendigvis sandt, blot fordi resultatet er ”statistisk signifikant”.